2025.11.17

국내 LLM, 해외 대비 안전성 82% 수준…숭실대 AI 안전성 연구센터 발표

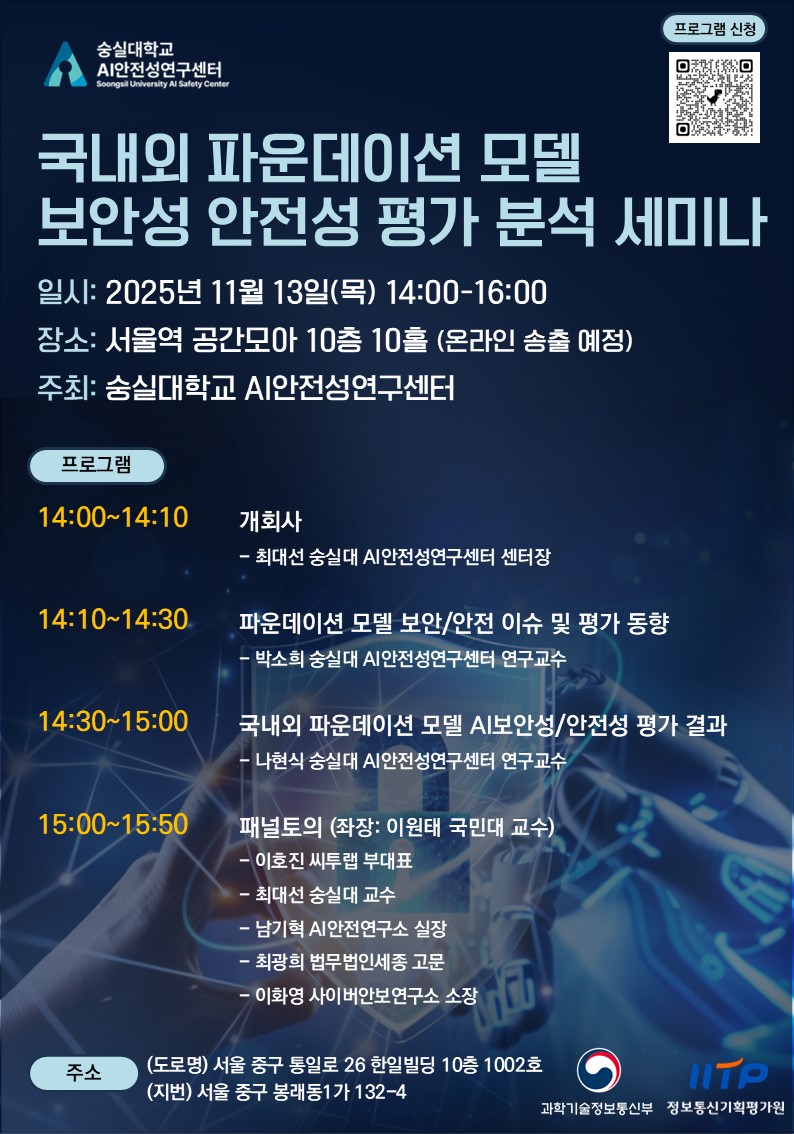

- 57종 공격 평가 결과 공개…SKT·LG·카카오 등 국내 모델, 글로벌 GPT·Llama 대비 취약- AI 레드티밍 플레이그라운드 필요성 제기, 위협정보공유·지속적 레드티밍·방어기술 테스트·인력양성 숭실대학교(총장 이윤재) AI안전성연구센터(센터장 최대선, 정보보호학과 교수)는 국내외 주요 파운데이션 모델(LLM) 20종을 비교한 결과, 국내 모델의 보안성과 안전성이 해외 대비 약 82% 수준에 그친다고 13일 밝혔다.이번 분석은 ‘국내외 파운데이션 모델 보안·안전성 평가 세미나’에서 공개됐으며, 과기정통부·정보통신기획평가원의 ‘정보보호핵심원천기술개발사업’ 연구과제의 일환으로 수행됐다.연구팀은 1.2B부터 660B 규모까지 다양한 모델을 대상으로 프롬프트 인젝션, Jailbreak, 유해 콘텐츠 생성 유도 등 총 57종의 최신 공격 기법을 적용했다. 평가 모델에는 SKT A.X, LG EXAONE, 카카오 Kanana, 업스테이지 Solar, 엔씨소프트 VARCO 등 국내 모델과 OpenAI GPT 시리즈, DeepSeek R1, Meta Llama, Anthropic Claude, Alibaba Qwen 등 해외 주요 모델이 포함됐다. 또한 모델을 직접 설치해 실행하는 ‘단독형’과 기업이 제공하는 보안 기능이 포함된 ‘서비스 통합형’을 구분해 평가한 점이 특징이다.서비스 통합형 평가에서는 Anthropic Claude Sonnet4가 628점으로 가장 높은 보안·안전성을 보였고, OpenAI GPT-5가 626점으로 뒤를 이었다. 국내 모델 중에서는 J모델이 495점을 기록하며 세 번째에 해당됐다. 해외 모델 점수 범위는 628~317점(평균 447점), 국내 모델은 495~299점(평균 385점)으로, 국내 모델의 상대적 수준은 약 86%였다.단독형에서는 GPT-oss 20B가 487점(700점 만점)으로 가장 높은 안전성을 보였고, DeepSeek 7B가 477점으로 뒤를 이었다. 국내 모델 중에서는 C모델이 416점을 기록했다. 해외 모델 평균은 432점, 국내 모델 평균은 350점으로, 국내 모델은 해외 대비 약 81% 수준을 보였다. 두 형태를 종합하면 국내 모델의 상대적 수준은 약 82%로 평가됐다.국내 모델은 대부분의 공격 유형에서 해외 모델보다 낮은 안전성을 보였으며, 특정 공격에서는 모델별 편차가 크게 나타났다. 또한 해외 모델은 한국어·영어 안전성 차이가 거의 없었으나 국내 모델은 한국어가 상대적으로 더 안전한 경향을 보여 언어적 편차도 확인됐다.최대선 숭실대 AI안전성연구센터장은 “국내 모델은 보안성 측면에서 해외 모델보다 낮은 수준을 보였다”며 “그동안 국내에서는 단순 벤치마크 기반의 안전성 평가에 머물렀고, 높은 기술력이 필요한 보안성 평가는 충분히 이루어지지 않았던 점이 배경으로 보인다”고 말했다. 이어 “경쟁력 확보를 위해서는 체계적 평가, 지속적 검증, 이에 필요한 기술 확보가 필수적이다”고 강조했다.행사는 두 개의 발표 세션으로 구성됐다.박소희 교수는 글로벌 주요 기관들의 AI 안전성 평가 동향을 소개하며, 해외에서는 공격·안전성 벤치마크가 제도적으로 자리 잡고 있다고 설명했다.이어서 나현식 교수는 국내외 모델 20종의 평가 방법과 보안·안전성 비교 결과를 발표했다.발표 후에는 이원태 국민대학교 교수(국가인공지능전략위원회 보안TF장)가 좌장을 맡아 산업·법제·안보·기술 전문가들이 참여하는 패널 토론이 진행됐다.㈜씨투랩 이호진 부대표는 “오픈소스 모델에 대한 공격 연구는 활발하지만, 실제 기업 환경에서 방어 기능이 적용된 모델에 대한 평가가 더 의미 있다”며 “한국어 기반의 공격과 평가가 더 반영되길 바란다”고 말했다.법무법인 세종 최광희 고문은 “AI 해킹 에이전트가 실제로 취약점을 탐지하고 상시 공격을 수행하는 시대가 됐다”며 “위험도가 높은 오픈소스 모델은 공개·관리 정책이 필요하다”고 밝혔다.AI안전연구소 남기혁 실장은 “AI 모델의 위험 범위가 매우 넓어 개별 기관이 대응하기 어렵다”며 “레드팀 정보와 위협 데이터를 공유하는 협력 체계와 제3자 검증 구조가 필요하다”고 강조했다.사이버안보연구소 이화영 소장은 “국가 단위의 복합적 사이버 위협이 정교해지면서 프롬프트 인젝션 같은 구조적 취약점 기반 공격이 더욱 위협적이다”며 “외부 데이터·시스템 권한까지 고려한 평가와 정책 대응이 필요하다”고 말했다.최대선 센터장은 ‘AI 레드티밍 플레이그라운드’ 구축 필요성을 강조하며 “AI는 빠르게 발전하고 위협도 동시에 고도화된다. 몇 년마다 나오는 가이드라인이나 연 1회 인증 방식으로는 따라갈 수 없다”고 지적했다. 이어 “최신 공격을 반영해 지속적으로 레드티밍을 수행하고, 그 결과를 공개·공유하며, 이를 토대로 방어 기술 개발이 선순환하는 체계가 필요하다”고 말했다. 또한 “AI 레드티밍 전문인력 양성도 중요하며, 플레이그라운드가 실전형 인재를 키우는 기반이 될 수 있다”며 “UC 버클리의 AI 레드티밍 부트캠프가 좋은 사례다”라고 설명했다.좌장을 맡은 이원태 교수는 “AI 모델의 보안성과 안전성을 객관적으로 비교·평가한 연구는 국내에서 처음 시도된 것으로, 향후 AI 보안 내재화를 위한 정책적·기술적 기반이 될 수 있는 의미 있는 시작점”이라며, “AI 기술이 발전함에 따라 보안 위협 역시 고도화되고 있어, 이를 체계적으로 평가할 수 있는 인프라와 거버넌스 구축이 시급하다”고 강조했다. 이어 “AI 보안은 단순한 기술 이슈가 아니라 산업, 법제, 국가안보까지 아우르는 종합 과제이며, 보안은 안전의 전제가 되고 안전은 보안을 사회적으로 확산시키는 핵심 요소”라고 덧붙였다.숭실대 AI안전성연구센터는 최신 공격을 반영한 동적 평가체계 구축, AI 에이전트를 활용한 자동화 레드티밍 기술 개발, 공격·안전성 데이터 공유 플랫폼 구축을 추진한다. 아울러 평가 대상을 Agentic AI, 멀티모달 모델, Physical AI 등으로 확장해 국내 AI 모델의 안전성과 신뢰성을 높이는 연구를 이어갈 계획이다.